Vagy talán a szinte varázslatos és meseszerű művészi koncepciók kápráztatták el a szemed világát a neten? Most segítünk, hogy könnyebben felismerd, mikor is találkozol a mesterséges intelligencia (MI) által készített képekkel.

Természetesen nem Ferenc pápa az egyetlen, akit az MI segítségével lehetetlen helyzetben ábrázoltak. Más ismert vagy híres személyeket is feltűntettek már hasonlóan abszurd vagy nevetséges, de mindazonáltal abszolút hamis szituációkban, például Elon Muskot vagy Valgyimir Putyint is. Ez persze meglehetősen szórakoztató játék, egészen addig a pontig, míg nem manipulációs szándékkal vagy politikai nyerészkedéssel teszik ezt. Azonban a fake news és a deep fake korszakába érve ez egy meglehetősen fenyegető veszély, így nem árt felkészültnek lenni, és alaposan megvizsgálni a kétesnek tűnő képeket, videókat. Íme néhány tipp, ami a segítségedre lehet ebben.

1. Keresd a forrást!

Talán egyértelműnek hangzik ez a tanács, de sosem elég hangsúlyozni, hogy ez az elsődleges módja annak, hogy felfedd a kép eredetét. Ha valahol megosztva látod az adott fotót, olvasd el a képaláírást és a kommenteket, hiszen jobb esetben a feltöltő jelezte azt, ha MI segítségével generálta a képet. Ha nem találsz erre utaló leírást az aktuális platformon, az még nem azt jelenti, hogy nem tudod bizonyítani a sejtésed. A legjobb ha képkereső felületekre is beilleszted az adott fotót, a Google, a Tineye vagy a Yandex is alkalmas lehet erre a feladatra. Ők be fogják dobni az összes forrást, ahol a neten megjelenhetett a kép, az már a te dolgod, hogy eldöntsd, melyik lehet az eredeti.

2. Van vízjel?

Szintén banális megoldásnak tűnhet, azonban cseppet sem kihagyható lépés: keresd a vízjeleket! Tény, hogy nem minden MI képgenerátor tesz vízjelet az illusztrációra, a Midjourney vagy a DeepAI például nem, de a DALL-E lehet ez alól kivétel. A DALL-E vízjelében, a jobb alsó sarokban öt színes kis kocka követi egymást a következő sorrendben: sárga, türkíz, zöld, piros és kék. Ha ezeket a kockákat felfedezed a képen, akkor biztos lehetsz benne, hogy az OpenAI DALL-E programja generálta. Természetesen ez a vízjel is eltávolítható, ha a készítő ismeri a módját, így ez sem garancia arra, hogy felismerd az MI által készített képeket.

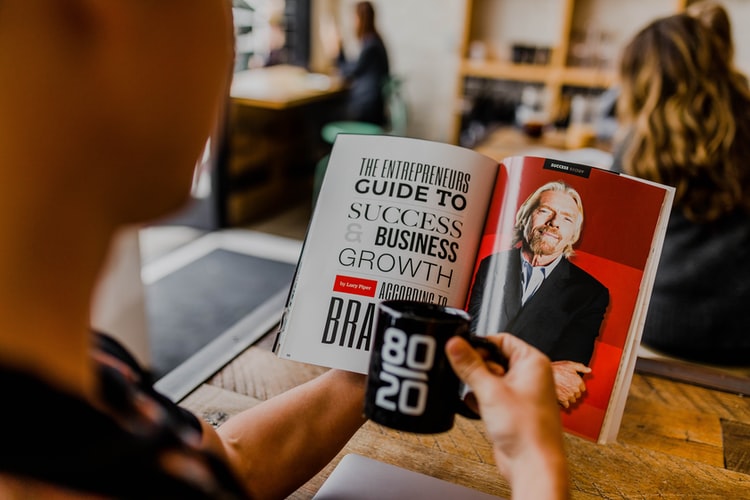

3. Anomáliák és furcsaságok

A mesterséges intelligencia által készített fotók első pillantásra valódinak tűnhetnek, de aztán ha jobban megnézed, könnyen rájöhetsz a turpisságra. Ezért nagyíts rá részletekre, vizsgáld meg alaposan az alkotást, ugyanis érdekes anomáliákat fedezhetsz fel. Ilyen például a gravitáció törvényeinek való ellentmondás, a tárgyakról hiányzó darabok, többször is felbukkanó azonos elemek a háttérben, vagy a furcsán elmosódó részletek. Továbbá akkor is van okod gyanakodni, ha az egész háttér elmosódott, és tisztán látszik, hogy azt nem egy valódi kamera, hanem digitális technológia blőrözte ki. Valamint annak se dőlj be, ha fotó túl szép ahhoz, hogy igaz legyen, tökéletesen megkomponált emberek, állatok, tájak és fények összessége aligha találkozik egy képen.

4. Emberábrázolás

A túl esztétikusra generált fotókon túl, az MI-re jóval jellemzőbb a hibázás, különösen akkor, ha személyeket valószerűen szeretne bemutatni. Sokáig a kézfejről és az ujjak számáról lehetett megállapítani, hogy egy képet a mesterséges intelligencia generált, hiszen vagy kevesebb (3-4), vagy több (6-7) ujja volt a képeken az embereknek. Mára ezt a hibát már nagyjából kiküszöbölték a fejlesztők, de még így is számos rendellenesség felbukkan az MI emberábrázolásában. Csak néhányat kiemelve: aránytalan méretű, vagy deformált testrészek; túlságosan aszimmetrikus arc; egyik szem nagyobb vagy hiányzik; meglehetősen ferde fogsor; furcsa formájú fülek, szemüvegek és fülbevalók arcba olvadása, páratlansága.

5. Felismerő programok

Szinte már mindent sorra vettél, de még így is bizonytalan vagy a kép forrásában? Akkor még egy bónusz javaslatunk van, ez pedig a felismerő programok alkalmazása. Erre az úgynevezett GAN (Generative Adversarial Networks) detektorokat ajánlják, amik képesek lehetnek megállapítani, hogy MI generált képről van-e szó vagy sem. Azonban egyelőre nem szabad készpénznek venni ezen programok állításait, ugyanis jelenleg még igen nagy arányban tévednek, körülbelül 50 százalékos pontossággal működnek csak. Tehát fifty-fifty az esélye, hogy éppen helyesen kiáltanak ki egy képet MI generáltnak, holott lehet, hogy az tényleg egy valódi fotó.

Összeségében elmondható, hogy a technológia folyamatos fejlődésével, az MI generált képek a jövőben csak egyre hibátlanabbak és realisztikusabbak lesznek, ezáltal még nehezebb lesz felismerni őket. Így könnyen lehetséges, hogy a fentebb felsorolt praktikák hamar idejétmúlttá válnak, azonban abban még bízhatunk, hogy a felismerő programok is fejlődnek annyit, hogy a mainál nagyobb bizonyossággal lehessen őket alkalmazni. Záró kérdés: szerinted a cikkben szereplő képek közül hány készült az MI segítségével?

Források: makeuseof.com, dw.com, time.com

Képek forrása: deepai.org

2023

. Június 23.

2023

. Június 23.

5 perces olvasmány

5 perces olvasmány

További híreink

További híreink